La reconnaissance faciale ou l'œil du colonisateur

Thibault Prévost - - Numérique & datas - Clic gauche - 29 commentairesD'Israël à l'Afghanistan, de l'Inde à la Chine, les technologies de surveillance automatisée épousent des projets politiques coloniaux et ségrégationnistes. À coups d'intelligence artificielle et de collecte biométrique, jamais l'œil du colonisateur n'a été si perçant.

Ils l'ont appelé Blue Wolf, le loup bleu. Lui, c'est le système de surveillance électronique discrètement déployé depuis deux ans par l'armée israélienne dans les territoires palestiniens occupés, dont le Washington Post a révélé l'existence le 8 novembre (à partir d'informations obtenues par l'ONG israélienne Breaking The Silence, qui récolte des témoignages d'anciens soldats). Son but : contrôler en un clin d'œil, automatiquement ou manuellement, tout Palestinien présent sur le territoire, et ordonner – ou non – au soldat d'intervenir. Dans la vieille ville d'Hébron, site sacré pour les trois religions monothéistes, 40 000 Palestiniens cohabitent avec 400 à 850 colons israéliens. Désormais, dans ce territoire-apartheid, renommé H2 par l'occupant, atomisé par les checkpoints et les watch points (recensés sur la carte interactive de l'ONG Hebron Apartheid),chaque Palestinien peut être contrôlé puis pris en photo à l'improviste par l'un des 2000 soldats israéliens. Ensuite, trois possibilités : l'écran du téléphone affiche vert, rien ne se passe. Jaune, vous êtes placé en détention provisoire. Rouge, vous êtes arrêté. Implacable.

Le système, d'une efficacité glaçante, repose sur quatre dispositifs. Tout d'abord, une application pour smartphone, Blue Wolf, capable de scanner les visages et les codes-barres des cartes d'identité des Palestiniens. Ensuite, une base de données biométrique, le Wolf Pack, que l'un des soldats décrit anonymement comme un "Facebook pour Palestiniens"

, qui rassemble les visages des Palestiniens enregistrés, une montagne de données personnelles (liens familiaux, niveau d'éducation, etc...), et un identifiant unique qui définit leur "note de sécurité" personnelle. Ensuite, un réseau de caméras de surveillance "intelligentes", dotées de capacités de reconnaissance faciale automatique, installées en 2020 dans la zone H2, et présentées alors comme de "simples" caméras de vidéosurveillance pour faire émerger une "Hebron Smart City" (la "ville intelligente" a bon dos). Enfin, une seconde application pour smartphone, White Wolf, distribuée (officiellement depuis 2019) aux colons juifs (plus particulièrement à leurs responsables locaux de sécurité) installés en Cisjordanie, à Hébron et dans la colonie voisine de Kiryat Arba, où résident 8000 habitants. Son utilité : contrôler les allées et venues des employés palestiniens des colonies, en scannant leur carte d'identité.

Depuis un an, Tsahal fait dans le ludique : ses soldats sont encouragés à photographier le plus de Palestiniens possible, sans distinction, enfants inclus, au rythme de "plusieurs centaines chaque semaine", selon les témoignages de soldats anonymes

Plus terrifiant encore, le Washington Post nous apprend, par la voix de quatre anciens soldats, comment la base de données biométrique a été bâtie. Comment, en l'espace de deux ans, les soldats israéliens ont – illégalement – collecté les visages de milliers de Palestiniens, à Hébron et dans le reste du territoire occupé, et constitué une base de données biométriques sans consentement des sujets. Via leurs caméras "intelligentes", qui enregistrent et identifient H24 sans demander la permission, mais pas que. Depuis un an, Tsahal a fait dans le ludique : ses soldats sont encouragés à photographier le plus de Palestiniens possible, sans distinction, enfants inclus, au rythme de "plusieurs centaines chaque semaine", selon les témoignages de soldats anonymes. Pire,les unités ayant collecté le plus de visages ont gagné des prix -une soirée de permission, par exemple. Un an plus tard, à l'autre extrémité du processus, un soldat prend ses ordres de l’État israélien, réduit à une pastille colorée sur un écran. Vert : laisser partir. Jaune : détenir. Rouge : arrêter. L'arbitraire en monochrome. Pour qui ? Le renseignement israélien, explique Libérationle 9 novembre. Pour quel motif ? Rien de tout cela ne s'affiche sur l'écran du soldat. Le soldat exécute, point.

Recenser, photographier, capturer, collecter, identifier, assigner, analyser, classifier, contrôler : le projet Blue Wolf déploie tout l'arsenal du projet colonisateur, dopé aux algorithmes et aux technologies de l'information. "La colonisation, écrit la journaliste turque Malaka Shwaikh sur TRT World,signifie la mort de la vie privée. Elle signifie l'invasion de vos espaces les plus intimes, où et quand le colonisateur le souhaite. (...) Les Palestiniens, à l'intérieur comme à l'extérieur de la Palestine, vivent déjà dans une dystopie technologique". Dystopie où "le secteur de la haute technologie recrute des entreprises privées pour assurer les fonctions coloniales de son régime militaire sur les Palestiniens", selon le sociologue Elia Zureik, spécialiste des régimes de surveillance au Proche-Orient. Israël n'est pas un cas isolé : partout dans le monde, l'intelligence artificielle et l'analyse de gros volumes de données (big data) sont mis au service de politiques coloniales. Au service de cette obsession cybernétique : tout connaître, sur tout le monde, dans chaque recoin du territoire.

En août dernier, lors de la chute de Kaboul, The Interceptrapportait que les Talibans avaient mis la main sur des appareils appelés HIIDE (pour "Handheld Interagency Identity Detection Equipment"), abandonnés par l'armée étasunienne en pleine retraite. Ces appareils portables, similaires à l'application Blue Wolf, étaient utilisés pour collecter des données biométriques (iris et empreinte digitale, notamment), constituer une base de données centralisée sur la population locale, vérifier l'identité d'une personne instantanément, et comparer les empreintes digitales relevées sur des bombes à la base de données. Selon la journaliste d'investigation Annie Jacobsen, autrice du livre First Platoon sur le sujet, le Pentagone ambitionnait de collecter les données biométriques de 80% de la population afghane, soit 25 millions de personnes. Personne, explique une source à The Intercept, n'avait jamais imaginé que cet outil de recueil biométrique (encore une fois effectué en-dehors de tout cadre légal) puisse changer de mains. Et qu'il puisse être un jour utilisé pour traquer les collaborateurs afghans de l'armée étasunienne, plutôt que ceux qu'elle considérait comme des menaces - car si les Talibans n'ont probablement pas les moyens techniques de l'utiliser, le renseignement pakistanais (ISI) les a. D'un occupant à un autre, les objectifs changent, le cadre technique reste. Ironiquement, explique Jacobsen au MIT Technology Review, ces outils pourraient permettre au groupe islamique d'obtenir ce que les Marines cherchaient : la "domination de l'identité" afghane.

Huawei et Alibaba ont tous les deux développé un système de caméras à reconnaissance faciale raciste, capables d'identifier spécifiquement un Ouïghour dans une foule.

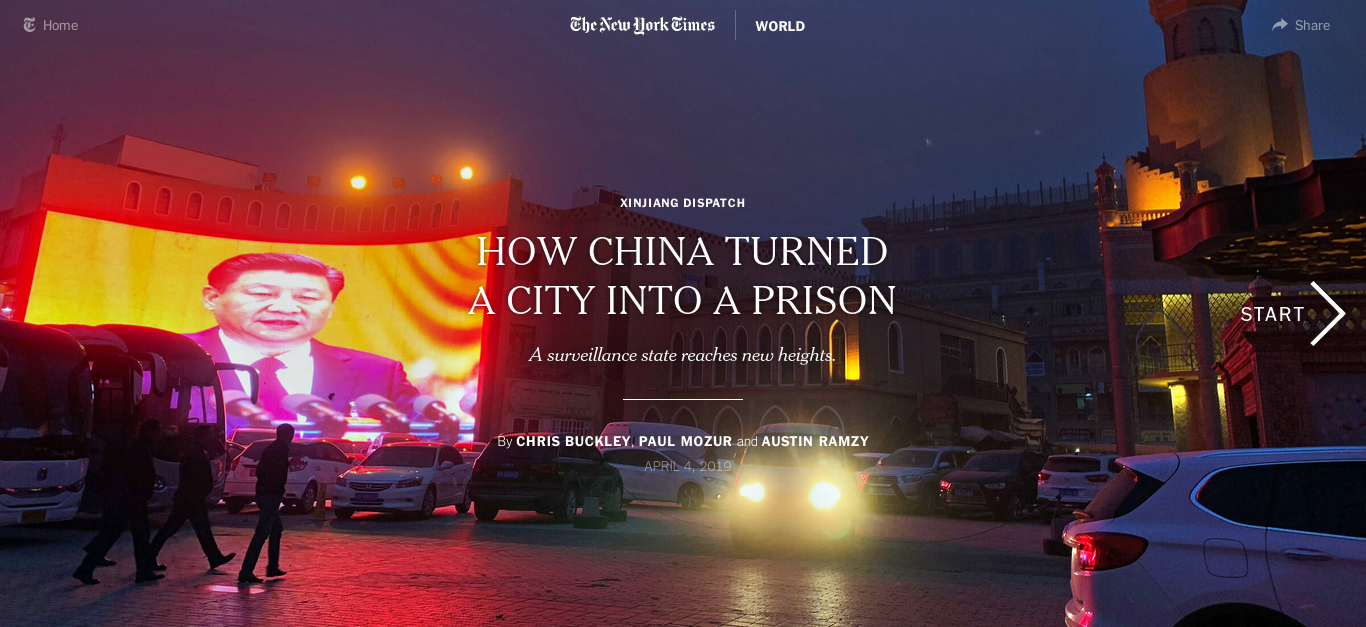

Plus à l'est, le nationalisme et les technologies de surveillance sont mariés depuis longtemps. En Chine, les champions nationaux de la tech

sont enrôlés dans le projet de surveillance totale de la minorité musulmane ouïghour au Xinjiang : Huawei et Alibaba ont tous les deux développé un système de caméras à reconnaissance faciale raciste, capables d'identifier spécifiquement un Ouïghour dans une foule. En mai dernier, la BBC alertait sur le déploiement d'un nouveau logiciel de surveillance, offrant aux caméras la capacité de détecter et d'analyser les émotions. Dans la ville de Kashgar, dont la majorité des 725 000 habitants appartient à l'ethnie ouïghoure, les dispositifs biopolitiques définissent un quotidien encore plus extrême qu'à Hébron. Checkpoints, contrôles d'identité permanents, reconnaissance faciale omniprésente, analyse de la voix, collectes d'ADN, et jusqu'à une refonte urbanistique pensée pour optimiser la surveillance de masse : la vieille ville a été partiellement démolie pour laisser place à de grandes avenues, plus propices aux objectifs des caméras et aux patrouilles, rapportait le New York Times en 2019. Pour Geoffrey Cain, auteur de The Perfect Police State, la Chine est aujourd'hui "l'État de surveillance le plus invasif que le monde ait jamais connu", qui transforme le quotidien en "une torture psychologique de masse".

Ce modèle techno-colonial clé en main, la Chine l'exporte généreusement à d'autres régimes autoritaires, impérialistes et ségrégationnistes, avec un catalogue de technologies adaptées à chaque situation. En Éthiopie, le géant des télécoms chinois ZTE fournit des solutions d'espionnage téléphonique visant la minorité autochtone oromo et leurs activistes. En janvier 2021, selon un rapport du groupe Insikt sur ce nouveau "colonialisme numérique chinois", quarante pays africains avaient signé des accords de transfert de technologies de surveillance et d'identification avec Pékin, dans le cadre de l'initiative économique titanesque "une ceinture, une route" ("Belt and Road Initiative"). En Asie centrale, Pékin exporte son modèle de gouvernance numérique coloniale tout le long de la "route de la soie numérique"("Digital Silk Road"), lancée en 2015, avec les mêmes ambitions.

L'Inde, ancienne colonie britannique, développe après Pékin le second système biométrique le plus ambitieux au monde : Aadhaar, lancé depuis 2010 avec le concours du français Safran, qui avale depuis dix ans une base de données après l'autre pour centraliser les services administratifs. Près d'1,3 milliard de profils biométriques (empreinte digitale, scan de l'iris, photo du visage) sont désormais enregistrés, au nom de l'optimisation bureaucratique. Les polémiques racontent une autre histoire : en 2016, la justice indienne rend le système Aadhaar obligatoire pour les étudiants issus de minorités souhaitant obtenir une bourse d'études ; la même année, ce sont les minorités religieuses en provenance du Pakistan qui doivent s'enregistrer dans la base de données ; en 2020, à Hyderabad, en pleins pogroms anti-musulmans, l'UIDAI, entité gouvernementale derrière Aadhaar, demandait à 127 citoyens de "prouver [leur] nationalité" via le système, générant une vague de panique dans la ville. En 2021, enfin, les migrants hindous venus du Pakistan sont obligés de s'enregistrer sur Aadhaar pour obtenir un vaccin anti-Covid.

Des ruelles d'Hébron à l'urbanisme panoptique de Kashgar, du 19e siècle à 2021, un continuum répressif se dessine dans l'espace et dans le temps.

Sous prétexte d'optimiser le fonctionnement de l'administration, Aadhaar permet également au gouvernement nationaliste hindou de Narendra Modi d'isoler les minorités – religieuses, sociales, mais également de genre – dans des citoyennetés partielles, à la carte, qui conditionnent leur accès aux services publics. Enfin, selon la chercheuse Priya Prabhakar, Aadhaar est mis au service de l'idéologie nationaliste "purificatrice" de Modi, comme un outil de reproduction des logiques coloniales, mais également des logiques de castes (en 2018, une fuite de données au sein d'Aadhaar démontrait que le fichier recensait la caste et la religion de certains individus, contrairement à ce qui avait été annoncé).

Des ruelles d'Hébron à l'urbanisme panoptique de Kashgar, du 19e siècle à 2021, un continuum répressif se dessine dans l'espace et dans le temps. Si les capacités des technologies d'analyse biométriques développées par la Chine ou Israël sont bien inédites, les méthodes de collecte de données et les finalités de cette surveillance empruntent aux manuels poussiéreux des empires coloniaux européens. Lesquels s'appuyaient sur cette idée fondamentale : connaître, c'est contrôler – ou, pour citer Michel Foucault, "il n’y a pas de relation de pouvoir sans constitution corrélative d’un champ de savoir." La scienceet la technique escortent le colon sur ses terres artificielles.Le premiersystèmed'identification biométrique moderne, par empreinte digitale, est né en Inde colonisée, en 1858, du magistrat britannique William James Herschel. Il s'étendra ensuite en Afrique du Sud et au Japon post-impérial, qui expérimentera la classification raciale. Tout au long du 20e siècle, l'Afrique du Sud sous apartheid, alors l'une des sociétés les plus ségrégationnistes au monde, restera le bastion de l'identification biométrique. Depuis une vingtaine d'années, écrit Keith Breckenbridge, les anciennes colonies servent de laboratoires à des expériences de gouvernance biométrique. Continuité.

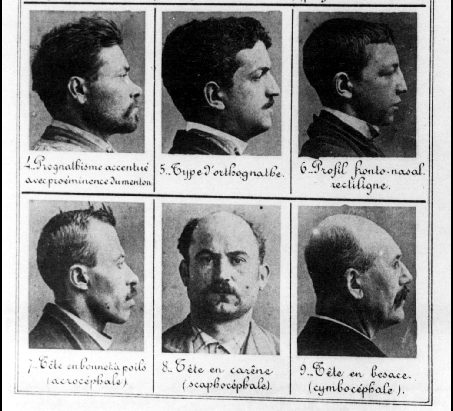

Au 19e siècle, la photographie, encore dans son enfance, va devenir l'outil de gestion privilégié d'une Europe coloniale en pleine frénésie classificatrice, comme l'explique Daniel Foliard dans son essai Combattre, punir, photographier. L'occupant britannique l'utilisera massivement en Inde, notamment via le projet "anthropologique" (et plutôt taxonomique) The People of India (1868-1875), pour recenser les différentes castes et ethnies du pays colonisé, en 486 clichés. En 1880, le Français Alphonse Bertillon invente la fiche d'identité photographique pour criminels – face, profil, circulez. Sa méthode, tantôt appelée "anthropométrie" ou "bertillonnage", est rapidement déployée dans les colonies françaises (avant d'être progressivement supplantée par la seule empreinte digitale).

Protégée et légitimée par la supposée "neutralité scientifique" de l'image photographique, l'anthropométrie coloniale, sorte de "raciologie" dopée au naturalisme du siècle, à la méthodologie foutraque (rappelle la chercheuse Emmanuelle Sibeud), va contribuer à cimenter une hiérarchie des races et des cultures et faire émerger la figure du "sauvage", clé de voûte argumentative qui légitimera le projet civilisationnel des puissances impérialistes européennes. Parallèlement, le recours au recensement photographique, comme celui de femmes algériennes dévoilées effectué par le photographe Marc Garanger pour l'armée française pendant la guerre d'Algérie, permet au pouvoir colonial de produire des individus, et d'aussitôt les placer sous son regard administratif. Une fois recensés, les colonisés deviennent des "citoyens de papier", écrivent Séverine Awenengo Dalberto et Richard Banégas en observant les régimes biométriques (de "biomaîtrise") africains contemporains, dont les titres d'identité n'ont, à l'opposé du passeport européen, pour seul pouvoir que celui de fermer des frontières.

Aux anthropologues d'hier succèdent les «data analysts» d'aujourd'hui ; à l'argument de la naturalité succède celui du calcul mathématique ; aux citoyens de papier succèdent les citoyens de données.

Un demi-siècle après l'indépendance algérienne, des raclements fétides émergent de la gorge de l'Histoire. L’œil cybernétique et l'IA, entend-on chez les camelots de la surveillance électronique, réussiraient là où le recensement et l'appareil photo auraient jadis échoué : identifier et contrôler, en toute neutralité. Le logiciel de reconnaissance faciale ne mentirait pas – tenez, regardez ces taux d'exactitude pour vous en convaincre ! Il suffit cependant de transposer Roland Barthes parlant de la photographie – qui, déjà, ne pouvait pas " être la transcription pure et simple de l’objet" – pour mettre à jour la subjectivité algorithmique. La réflexion n'a pas pris une ride : dans les mains du pouvoir impérialiste, l'appareil photo, la caméra de surveillance, la base de données et l'algorithme de reconnaissance faciale servent l'impérialisme. Ils deviennent des arkhè, à la fois auxiliaires d'une autorité coloniale et créateurs d'ontologies artificielles – telle ethnie est a priori dangereuse/sauvage/exotique, rayez les mentions inutiles. L'occupant devient un démiurge, capable de fabriquer des normes à sa guise.

Partout, le couple image-statistique produit des peuples. Lorsqu'on développe des réseaux de smart cameras voués à identifier et surveiller automatiquement les "attitudes suspectes" d'une ethnie en particulier, lorsqu'on réduit l’État de droit à un code couleur dans une appli, on encode des instructions déshumanisantes et racistes (qu'il faudra un jour cesser d'euphémiser en simples "biais") dans un système qui excelle ensuite à les reproduire. On programme des essentialismes en Python, on rédige des prophéties auto-réalisatrices, puis on les laisse advenir tranquillement - au rythme supersonique de l'apprentissage machine. Tel est le luxe qu'offre la rationalité algorithmique au colonisateur : la possibilité permanente du déni plausible. Le fameux "c'est pas nous, c'est l'algorithme", qui réduit toute oppression structurelle à un malheureux bug de programmation. L'algorithme, rappelle la philosophe Antoinette Rouvroy, cet auxiliaire technique indépendant, impartial (car mathématique), au-dessus de tout soupçon, baigné dans son liquide amniotique de données, dont émaneraient spontanément des catégories d'êtres hiérarchisées qui ne sauraient être remises en cause. Dans la boîte noire du machine learning réside la promesse d'une irresponsabilité ; celle d'une guerre sans soldats, d'une colonisation sans colonisateurs. Aux anthropologues d'hier succèdent les data analysts d'aujourd'hui ; à l'argument de la naturalité succède celui du calcul mathématique ; aux citoyens de papier succèdent les citoyens de données. Derrière le ripolinage technique, la même horreur inchangée : à l'ère du capitalisme de surveillance, les infrastructures de triage colonial sont partout, discrètement reconfigurées pour servir le profilage publicitaire, contrôler l'étanchéité des frontières occidentales et, à l'intérieur, la parfaite sécurité de leurs espaces publics. Prêtes à servir le nationalisme qui trépigne.

Vous avez aimé ce contenu ? Soutenez-nous ! Pour nous aider à mettre un maximum d'articles et d'émissions en accès libre, pour nous permettre de maintenir des tarifs d'abonnement abordables, pour que nous puissions continuer à enquêter en toute indépendance... Cette fin d'année est le bon moment pour nous soutenir par un don, défiscalisable à 66%.